Cientistas da computação finalmente demonstraram experimentalmente que a computação neuromórfica consome muito menos energia do que a computação tradicional.

A maior eficiência energética sempre foi um dos principais argumentos para o desenvolvimento de arquiteturas baseadas em componentes que imitam os neurônios e as sinapses, como os memoristores, porque a inteligência artificial é altamente intensiva em computação.

Mas a comparação direta ainda é complicada de ser feita porque quase todos os processadores inspirados no cérebro construídos até agora são experimentais e ainda bastante limitados.

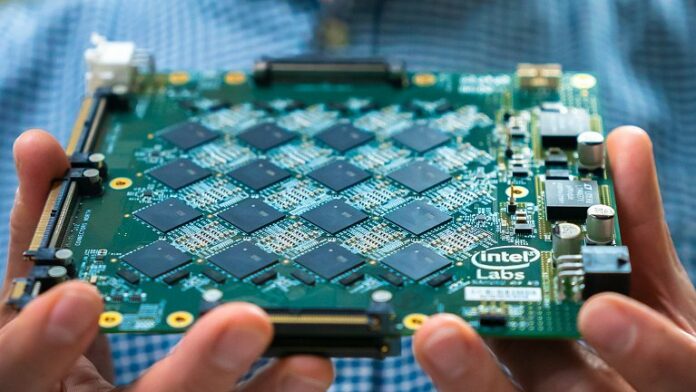

Agora, pesquisadores da Universidade de Tecnologia Graz, na Alemanha, conseguiram realizar o primeiro comparativo direto, rodando a mesma rede neural em um processador eletrônico tradicional e em um processador neuromórfico, neste caso o processador Loihi, fabricado experimentalmente pela Intel.

Os resultados mostram que, ao usar a rede neural para processar sequências, como frases, o processador neuromórfico consome entre quatro e 16 vezes menos energia do que o processador eletrônico.

Segundo a equipe responsável pelo comparativo, ganhos de eficiência adicionais serão obtidos conforme for disponibilizada a próxima geração de hardware Loihi, que melhora significativamente o desempenho da comunicação entre os chips.

Memória guardada na inatividade

No comparativo, a equipe focou em algoritmos que trabalham com processos temporais. Por exemplo, o sistema tinha que responder perguntas sobre uma história previamente contada e compreender as relações entre objetos ou pessoas do contexto. O hardware testado consistia em 32 chips Loihi.

“Estudos experimentais mostraram que o cérebro humano pode armazenar informação por um curto período de tempo mesmo sem atividade neural, nomeadamente nas chamadas ‘variáveis internas’ dos neurônios. Simulações sugerem que um mecanismo de fadiga de um subconjunto de neurônios é essencial para essa memória de curto prazo,” explicou o professor Wolfgang Maass, coordenador da equipe.

Ainda não existem provas diretas desse mecanismo porque essas variáveis internas ainda não podem ser medidas, mas o modelo estabelece que a rede só precisa testar quais neurônios estão atualmente fatigados para reconstruir quais informações foram processadas anteriormente. Em outras palavras, as informações anteriores são armazenadas na inatividade dos neurônios, e a inatividade consome menos energia.

Para fazer isso, a equipe desenvolveu um sistema que vincula dois tipos de redes de aprendizado profundo: As redes neurais de retroalimentação são responsáveis pela “memória de curto prazo” – vários desses chamados módulos recorrentes filtram possíveis informações relevantes do sinal de entrada e as armazenam; e uma rede de alimentação positiva determina então quais das relações encontradas são importantes para resolver a tarefa em questão.

As relações sem sentido são eliminadas, de modo que os neurônios só disparam nos módulos onde foram encontradas informações relevantes. Este processo, em última análise, também leva à economia de energia.

“Espera-se que as estruturas neurais recorrentes forneçam os maiores ganhos para aplicativos executados em hardware neuromórfico no futuro,” disse Mike Davies, membro da equipe. “Hardware neuromórfico, como o Loihi, é especialmente adequado para facilitar os padrões rápidos, esparsos e imprevisíveis de atividade de rede que observamos no cérebro, e precisamos dos aplicativos de IA mais eficientes em termos de energia.”

Todo o trabalho foi realizado em conjunto com a equipe responsável pelo Projeto Cérebro Humano, que reúne pesquisadores das áreas de neurociência, medicina e tecnologias inspiradas no cérebro.

Artigo: A Long Short-Term Memory for AI Applications in Spike-based Neuromorphic Hardware

Autores: Arjun Rao, Philipp Plank, Andreas Wild, Wolfgang Maass

Revista: Nature Machine Intelligence

DOI: 10.1038/s42256-022-00480-w